De la troli la TikTok. Procurorul general Alex Florenţa prezintă anatomia războiului hibrid al Rusiei împotriva României

Procurorul general Alex Florenţa a explicat marţi, într-o conferinţă de presă, modul în care Federaţia Rusă desfăşoară împotriva României un război hibrid sistematic, cu efecte directe asupra stabilităţii sociale şi politice.

„Este mai mult decât sigur că România va rămâne şi pe viitor ţinta unor astfel de campanii”, a declarat Florenţa.

Reţele subterane şi influenţe politice

Potrivit acestuia, strategia Moscovei include „cultivarea atentă, deseori sub pragul de detecţie, a unor reţele de afaceri, mass-media şi surse politice interne capabile să influenţeze deciziile guvernamentale”. În acest context, au fost amintite relaţiile unor parlamentari români cu Ambasada Rusiei.

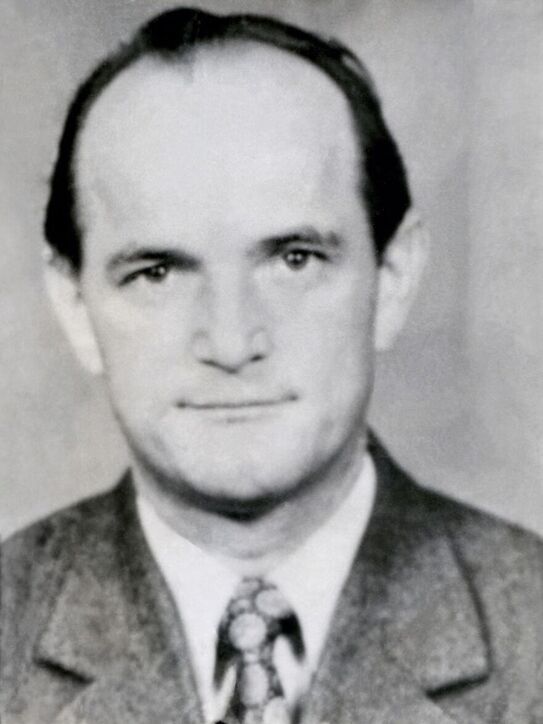

Un alt element major este exploatarea grupărilor extremiste româneşti. Cazul Marian Moţoc – trimis în judecată în 2024 pentru legături directe cu ataşatul militar rus – este doar un exemplu.

Intensificarea propagandei

Din noiembrie 2024, autorităţile au observat o creştere a mesajelor extremiste, instigatoare la ură şi violenţă, asociate campaniei de promovare a unui candidat independent la prezidenţiale. Conţinutul, generat inclusiv cu ajutorul inteligenţei artificiale, urmărea să inducă panică şi revoltă, fiind promovat prin canale pro-ruse şi preluat masiv de grupuri extremiste sau conspiraţioniste.

Un exemplu este hashtag-ul Revoluţie, lansat iniţial pe canale ruseşti de Telegram, care a ajuns să înregistreze peste 1,8 milioane de vizualizări şi 176 de videoclipuri pe zi.

Dezinformare şi manipulare online

Raportul procurorului general detaliază mecanismele utilizate: ferme de troli, reţele de boţi, conturi false, influenceri cooptaţi, dar şi tehnici sofisticate precum metoda „doppelgänger” – clonarea site-urilor oficiale de presă sau instituţii publice, pentru a distribui ştiri false greu de deosebit de cele autentice.

Florenţa a subliniat că au fost identificate patru mari tipuri de narative exploatate pentru manipularea publicului românesc:

-

identitar-nostalgic (nostalgia comunistă, reîntregirea familiei, inegalităţi sociale),

-

conspiraţionist,

-

religios/spiritual,

-

medicină alternativă.

Acestea au fost cultivate încă din 2019, prin campanii de microtargetare desfăşurate de companii cu legături certe în Federaţia Rusă, care au sondat vulnerabilităţile şi preferinţele utilizatorilor români.

Infrastructura campaniei

Procurorul general a explicat că Moscova a finanţat o vastă infrastructură online:

-

reţele de site-uri de tip clickbait şi clone („doppelgänger”),

-

pagini de Facebook şi conturi fictive,

-

campanii mascate prin reclame native ads.

Această reţea a fost activată în apropierea alegerilor prezidenţiale din 2024 pentru promovarea candidatului independent, prin milioane de comentarii, clipuri video editate, bannere şi mesaje coordonate pe Telegram şi TikTok.

Compania TikTok a confirmat, într-un raport oficial, că în România au acţionat două reţele coordonate de conturi false, provenind din Rusia, care au manipulat algoritmul platformei pentru a creşte vizibilitatea conţinutului pro-rus.

Obiectiv: polarizarea societăţii şi slăbirea din interior a statului

Scopul final al acestor operaţiuni, arată Florenţa, este menţinerea unei stări constante de teamă, confuzie şi revoltă, polarizarea societăţii şi erodarea încrederii în instituţiile statului.

„Se conturează ipoteza certă a influenţării spaţiului informaţional în vederea amplificării nemulţumirilor sociale, valorificate apoi prin acţiuni stradale de amploare”, a avertizat procurorul general.

Redăm în continuare declaraţiile făcute de Alex Florenţa în expunerea sa privind războiul hibrid dus de Rusia în ţara noastră:

Ne amintim de relaţiile şi de vizitele făcute la Ambasada Rusiei şi dezvoltate în ultimii doi ani de zile de mai mulţi parlamentari români.

Dar un element important care se regăseşte în spaţiul românesc este în momentul de faţă şi instrumentarea grupărilor extremiste româneşti. Ţinem minte de asemenea cazul Marian Moţoc, un personaj trimis în judecată de către parchet anul acesta şi care intrase în legături de coordonare directe cu Ambasada Federaţiei Rusiei la acel moment, în speţă cu ataşatul militar rus. Trebuie să avem în vedere faptul că, începând din cursul lunii noiembrie 2024, la nivelul comunităţilor extremiste, s-a constatat o intensificare a narativelor şi mesajelor instigatoare la ură şi violenţă, asociate campaniei de promovare a unui candidat independent şi au creat un climat de panică la nivelul societăţii.

Această creştere a volumului de conţinut instigator la acţiuni violente a fost iniţiată încă din perioada primului tur al alegerilor, evoluţia realizându-se însă în mod sistematic, prin promovarea unor elemente de conţinut de instigare la ură generate prin intermediul inteligenţei artificiale. Acest tip de narative şi modalitatea de realizare a conţinutului online corespund tiparului acţional al Federaţiei Ruse, fiind semnalate şi în alte state, precum Moldova sau Georgia. De asemenea, au fost utilizate canale de propagandă pro-ruse, după cum vom vedea, pentru promovarea acestor elemente de conţinut.

În ultimul rând, la nivelul reţelelor de socializare, au fost edificate mesaje instigatoare la ură la acţiuni violente, inclusiv împotriva autorităţilor, majoritatea ameninţărilor fiind conturate în jurul ideii de revoltă generală, mesajele conţinuţii intacte care exploatau sentimente nostalgice, ele făcând majoritar trimiterea la revoluţia din decembrie 1989. Este o inflaţie de astfel de mesaje în zona online, create într-o dată cu inteligenţa artificială, lucru care dovedeşte un comportament absolut artificial, dar care generează o tensiune, o stare de efervescenţă în rândul colectivităţilor care sunt adresate şi, evident, aceste mesaje sunt ulterior preluate şi viralizate prin intermediul diferitor grupuri extremiste din plan naţional. Dar pentru a înţelege mai bine cum funcţionează acest lucru, exemplificăm cu hashtag-ul Revoluţie.

Este un hashtag care, în spatele căruia a fost viralizată o întreagă gamă de mesaje de acest tip, incitatoare la ură şi la violenţă, în preajma primului tur al legilor prezidenţiale. Este un hashtag care provine şi este lansat undeva din infrastructura rusă de pe canalele de Telegram. El este ulterior viralizat printr-o întreagă infrastructură de sprijin la care vom reveni pe parcursul prezentării noastre.

El este asociat în mod automat cu două dintre hashtag-uri şi ajunge la un vârf de viralizare la peste 1.800.000 de vizualizări zilnic şi la 176 de videoclipuri postate zilnic, toate cu acelaşi tip şi cu acelaşi variantă de mesaj. Analizele efectuate au arătat că, începând cu 27.11, s-a constatat o intensificare a campaniei de promovare a candidatului la prezidenţiale la nivelul unor grupuri cunoscute pentru diseminarea de narative de dezinformare, care asigură legătura dintre comunitatea pro-rusă şi alte comunităţi generatoare de riscuri pentru ordinea publică, în special grupări extremiste şi conspiraţioniste. Au fost identificate astfel narative prin care au este promovat candidatul la nivelul la peste 40 de grupuri de acest tip şi au totalizat peste 1.300.000 de membri.

Ei bine, toate aceste acţiuni de promovare a conţinutului instigator la ură relevă un comportament artificial, după cum spuneam, intensitatea efervescenţelor din plan social cu volumul acela uriaş de media-conţinut de acest tip fiind vădit disproporţionat faţă de manifestările din spaţiul public, din spaţiul real fizic.

Se conturează astfel ipoteza certei influenţări a spaţiului informaţional în vederea amplificării unor stări de nemulţumire, valorificabile apoi prin generarea de acţiuni stradale de amploare.

În ceea ce priveşte componenta de dezinformare şi propagandă, care este mult mai evidentă pentru spaţiul public românesc şi care trebuie să cunoască, în acest moment, cu ocazia acestei prezentări, o dezvoltare un pic mai largă, trebuie să avem în vedere câteva elemente.

În primul rând, o evoluţie a campaniei de dezinformare, pentru că aceasta presupune anumiţi paşi obligatorii care se vor regăsi, plecând de la un aspect pur doctrinar la cel practic, cu fidelitate şi în ceea ce priveşte modul în care a fost targetat spaţiul românesc. Va trebui să înţelegem, în primul rând, felul în care a fost targetată populaţia românească pentru identificarea anumitor narative receptibile şi, în al doilea rând, infrastructura pusă în joc în această campanie, care a dus, în cele din urmă, la o amplificare artificială a rezultatelor în punctul-cheie al alegerilor prezidenţiale.

Trebuie să înţelegem faptul că ecosistemul online utilizat în momentul de faţă de actori din Federaţia Rusă priveşte o gamă largă de instrumente, plecând de la site-uri şi componente de mass-media de stat tradiţionale, care răspândesc şi încep să creeze anumite ştiri şi se vor regăsi şi în România, după cum vom arăta, precum şi răspândirea ulterioară prin diferite site-uri şi bloguri create în special pentru crearea şi diseminarea acestui conţinut.

Sunt utilizate, de asemenea, în acest instrumentar ferme de trolli. Pentru cei care nu înţeleg ce sunt acestea, vorbim de conturi false, care imită un cont oficial şi se pretind utilizatori autentici, precum şi reţele întregi de boţi.

Acestea sunt instrumente prin care se amplifică artificial vizibilitatea unui anumit conţinut, fie prin comentarii, fie prin click-uri de satisfacţie şi aşa mai departe. Şi, desigur, o reţea de influenceri cooptaţi care nu fac decât să replice unele dintre narativele în favoarea Federaţiei Ruse. Toate plecând de la un conţinut viral, simplu, emoţional şi, mai ales, uşor de distribuit, după cum vom vedea.

După cum spuneam, ciclul campaniei de dezinformare presupune şi implică mai mulţi paşi. Primul este cel de localizare şi adaptarea narativelor. Este esenţial pentru cel care doreşte să dezinformeze să-şi adapteze mesajele, evident, la contexte naţionale care au un impact pentru populaţia statului respectiv.

Pentru că nu fiecare segment de populaţie urmăreşte obligatoriu aceleaşi lucruri, fie că vorbim de energie, migraţie, corupţie sau, în cazul nostru, alegeri în 2024. Ei bine, pe parcursul investigaţiilor derulate au fost identificate patru companii cu legături certe în Federaţia Rusă, care, atât anterior, cât şi în perioada premergătoare scrutinului electoral din 2024, au derulat activităţi informaţionale prin dezvoltarea şi susţinerea unor sisteme informatice complexe, după cum vom vedea. Site-uri create pentru distribuirea de conţinut maliţios, pagini de social media care prezintă un comportament neautentic, coordonat şi, mai ales, conţinut generat cu inteligenţă artificială, reclame de tip native ads – şi le vom explica pentru cei care nu le recunosc în ce constau acestea – reţea de influenceri.

Toate targetând în mod direct populaţia României. Ei bine, în concret, în cazul acestui ecosistem, la care vom reveni, după cum spuneam, pe parcursul prezentării, a fost identificată o reţea amplă de site-uri, al căror trafic a fost determinat de reclame promovate, în majoritatea cazurilor, de patru companii cu legături certe în Federaţia Rusă. Aceste conexiuni ale companiilor de care vorbesc cu Federaţia Rusă sunt relevate de multiple elemente.

Locaţiile unde figurează uneori sediile internaţionale ale acestor companii se află uneori în clădiri care nu sunt afişate simboluri, nu sunt elemente de vizibilitate aferente companiilor, cum ar fi un centru comercial, existând aşa suspiciunea că aceste sedii sunt fictive. Analizând istoricul acestor companii, a rezultat că figurează, ca fiind înfiinţate, unele dintre ele, în Federaţia Rusă, uneori cu finanţare din partea unor holdinguri de investiţii ruseşti. Marca companiilor este uneori înregistrată de către alte firme cu sediul în jurisdicţii offshore, firme care, schimb, sunt la rândul lor administrate de alte companii din Federaţia Rusă.

Nu în ultimul rând, în conducerea şi personalul unora dintre aceste companii au fost identificate persoane comune, aspecte ce evidenţiază legătura între acestea şi o posibilă coordonare comună. După cum spuneam, orice campanie de dezinformare trebuie să plece de la ideea de a-ţi pregăti şi identifica narativele cu care să bombardezi zona ţintă. Ei bine, în perioada premergătoare scrutinelor electorale, spaţiul informaţional al României a fost modelat în vederea influenţării percepţiilor colective prin diseminarea mesajelor ţintite către audienţe susceptibile la manipulare.

În acest scop, au fost realizate activităţi de sondare prin intermediul uneia dintre companiile la care făceam referire, care a adoptat o campanie sofisticată de microtargetare a populaţiei româneşti, vizând identificarea segmentelor vulnerabile şi gradul de receptivitate al acestora la anumite tipuri de narative. Astfel, încă din cursul anului 2019, una dintre companiile de native events, identificate în legături cu Federaţia Rusă, a realizat mai multe sondaje privind preferinţele de conţinut în mediul online ale utilizatorilor din România, inclusiv personalizate în funcţie de regiunea geografică, identificând tipul de conţinut care, plasat astfel în diferite articole sau reclame, putea creşte numărul de accesări. De ce era nevoie de o microtargetare a populaţiei? Tocmai din motivele menţionate: având în vedere dinamica existentă în spaţiul informaţional, utilizatorii consumă o gamă variată de conţinut, ceea ce permite companiilor implicate în procedurile de dezinformare să targeteze şi să grupeze populaţia pe nişe comportamentale.

Ei bine, din investigaţiile efectuate, rezultă că în urma acestei activităţi de microtargetare a spaţiului românesc au fost identificate patru tipuri de narative mari, la care segmente laşi din populaţie se dovedeau receptive şi care, aşa cum vom arăta, vor fi folosite începând cu anul 2022 de infrastructura online implicată în atacurile hibride în scopul segmentării populaţiei româneşti şi creării unor curente de opinie ulteriori exploatabile în momente cheie, cum au fost ulterior alegerile prezidenţiale din toamna anului 2024. Aceste patru tipuri de narative identificate sunt cele pe care le vedeţi în momentul de faţă afişate, identitar nostalgic, conspiraţionist, zone de religie şi spiritualitate în sensul larg şi medicină alternativă. Pentru toţi cei care am urmărit spaţiul online cu mai multă sau mai puţină atenţie în ultimii ani de zile, constatăm că aceste tipuri de narative care... mesajele, postări, conţinut care corespunde acestor patru narative este cel care se regăseşte în proporţie de peste 90% în întreg mediul online.

Şi pentru a evidenţia cu câteva exemple, elementele de conţinut identitar nostalgic, cum a fost el încadrat, prin care au fost promovate narative în schimb cu puternic impact emoţional, care ţin populaţia într-o stare de tensiune, într-o stare de dezechilibru, care duc la polarizarea societăţii, mai ales prin raportare la autorităţile oficiale. Fie narative legate de reîntregirea familiei, nostalgie după perioada comunistă şi acum înţelegem discuţiile din spaţiul public în ultima perioadă cum de a apărut din nou mai ales în zona populaţiei tinere această apetenţă pentru perioada anterioară a lui 1989, de asemenea diferite retorici privind inegalităţile sociale.

În fine, un segment al paginilor în cauza abordează şi ştiri cu caracter general de actualitate la nivel naţional, astfel de acţiuni fiind specifice de altfel tehnicilor de manipulare ale federaţiei ruse.

În speţă specularea informaţiilor de interes în spaţiul public pentru creşterea nivelului de interacţiune. Abordarea acestor tematici în schimb se face întotdeauna într-o notă alarmistă, cu o tentă conspiraţionistă şi ne aducem aminte de diferite elemente de ştiri care au apărut în spaţiul public din această gamă. De asemenea, în urma activităţilor de monitorizare a spaţiului informaţional a fost identificată şi o campanie de inundare a mediului online cu narative conform cărora de militar de rang înalt sau rude ale acestora au decedat, dar şi cu narative privind producerea unor dezastre naturale.

Totul încă odată urmăreşte încă odată crearea unei stări de tensiune, de teamă, de angoasă în rândul opiniei publice, care prin aceste trăiri ajunge la un moment dat să se polarizeze pe diferite segmente de opinie. Toate aceste articole din această gamă, de exemplu, provin de pe anumite site-uri, unele între ele sunt menţionate mai jos, şi că au fost distribuite la nivelul platformei Facebook în cadrul unor grupuri aferente comunităţilor locale, de către utilizatori care prezintă însă un anumit tipar cert. Respectiv, sunt fie cetăţeni străini de origine africană, fie utilizatori anonimi, prin urmare o reţea de distribuţie coordonată din alte zone.

Şi ca simplu exemplu, la nivelul acelui site îngroşat, scholarsden.info, au fost identificat acelaşi tipar operaţional de diseminare al narativului şi în legătură cu preşedinţii Republicii Cehe, Slovacii şi Sloveniei, nu doar în legătură cu demnitari români, lucru care dovedeşte, încă o dată, o infrastructură coordonată din altă parte. Un alt segment este reprezentat de paginile cu tematică religioasă, în care nu sunt abordate ştiri, însă sunt diseminate mesaje cu caracter de spiritualitate, inclusiv de promovarea tradiţiilor româneşti a elogierii vieţii la sat. Sunt teme care, ulterior, aveau să fie subsumate însă agenda promovată de fostul candidat independent şi susţinute anterior în spaţiul public pentru influenţarea mentalului colectiv.

În acest context, prin raportare la anumite valori identitare, sunt promovate mesaje eurosceptice conotative. După realizarea acestor narative şi încadrarea lor în cele patru tipuri mari la care ne-am referit, următorul ciclu al unei campanii de dezinformare presupune adaptarea infrastructurii necesară pentru plantarea narativelor în sânul segmentelor de populaţie anterior identificate. În cazul României, metoda folosită şi care a fost dezvoltată pe larg este aşa numită metoda doppelganger, pe care o vom explica foarte pe scurt.

Este o metodă operaţionalizată de Federaţia Rusă după invazia din Ucraina din anul 2022. Metoda de tip doppelganger este o tactică folosită în campanii de dezinformare în mediul online pentru a crea şi distribui informaţii false sau manipulate astfel încât să pară că provin din surse oficiale. În mod concret, cum se realizează acest lucru? În primul rând, sunt clonate site-uri sau conturi pe social media ale unor instituţii publice sau agenţii mass-media de renume, dar cu mici diferenţe de nume sau aspect.

Aceste site-uri clonă imită vizual şi stilistic sursa originală tocmai pentru a părea autentice şi a crea confuzii. Pe aceste site-uri clonă sunt postate ulterior articole, ştiri, postări, care par reale, dar conţin informaţii denaturate, exagerate, complet fabricate, dintr-unul din cele patru tipuri de narative la care făceam referire. Adesea sunt subvizate şi subiecte sensibile, politică, sănătate, război, crize economice.

Conţinutul este apoi distribuit masiv prin conturi false sau automatizări de reţele boţi, grupuri de discuţii şi forumuri. Ce se urmăreşte, în primul rând, crearea unei impresii de consens cu privire la acest tip de ştiri. Scopul nu e doar ca oamenii să creadă o minciună sau o ştire falsă, ci să nu mai ştie în cine să aibă încredere, pentru că dacă cu publicul devine confuz şi sceptic faţă de toate sursele de informare, inclusiv cele reale, autentice, atunci atacul de tip doppelganger este considerat ca realizat cu succes.

Această metodă de care vorbim a operat în România în felul următor şi imaginea postată în acest slide vrea să fie edificatoare, toţi ştim de varianta matroşca. De păpuşă în păpuşă. În acest tip funcţionează metoda doppelganger şi în România.

Un site creat în intermediul altui site. În acest scop, la nivel naţional, a fost identificată o reţea amplă de site-uri doppelganger, adică de site-uri clonate ale unor instituţii publice sau agenţii de presă oficiale, care imită imaginea site-urilor acestora, pentru a induce în eroare populaţia, prin intermediul cărora erau ulterior promovate iniţial materiale ce se încadrau în cele patru tipuri mari de narative identificate ca având o receptivitate largă în rândul populaţiei din România. Întreaga infrastructură este susţinută prin intermediul a peste 2000 de pagini de Facebook, care distribuiau elemente de conţinut generat de inteligenţa artificială, scopul acestora fiind de microtargetarea audienţilor vulnerabile şi expunerea acestora la narative maliţioase.

Toate aceste pagini de Facebook redirecţionau traficul, după cum vom arăta în câteva exemple, către site-uri autohtone de tip clickbait, adică site-uri ce postează un conţinut online adesea bazat pe titluri senzaţionale sau înşelătoare, care au scopul de a genera cât mai multe click-uri şi implicit trafic pe site-uri web. Titlurile sunt menite de sigur să atragă atenţia prin apelul la emoţii puternice, curiozitate, indignare, surprindere. Pentru promovarea tuturor acestor site-uri şi pagini de Facebook din infrastructura folosită s-au utilizat reclame pe principalele platforme online prin intermediul tehnologiei native ads furnizată de cele patru companii semnalate cu legături în Federaţia Rusă.

Plata acestor reclame la rândul lor era realizată prin intermediul unor pagini şi conturi de socializare fictive. Ei bine, reclamele de tip native ads, pentru a înţelege şi mai bine cum funcţionează acest tip de metodă. Şi pentru cei care nu înţeleg ideea de native ads, cu excepţia colegilor din mass media, trebuie să arătăm că acestea tipuri de anunţuri arată ca un conţinut obişnuit dintr-un site sau de o aplicaţie.

Un articol, o postare care apare ca un aspect normal şi identitate vizuală similar. Astfel, o companie, cum sunt cele de care făceam referire, creează şi plăteşte pentru plasarea unui articol la unui video a unei postări cu un anumit mesaj. Platforma online, de datul de aia faţă, site-ul de ştiri, blog, reţea socială prezintă, publică, într-un format care seamănă cu restul conţinutului de pe cel site respectivul anunţ.

Utilizatorii îl văd, interacţionează cu el ca şi cum ar fi un conţinut obişnuit, de multe ori fără a realizea că este o formă mascată de reclamă către un alt site. În fine, prin accesarea site-urilor de care vorbeam şi ştirilor de pe aceste site-uri, utilizatorul era redirecţionat la a treia mână către site-uri de tip doppelganger la care făceam referire, adică aceste tipuri de site-uri clonate unde se regăseau respectiv câteva ştiri ca şi altele asemănătoare ce prezentau credibilitate sporită întrucât păreau să... Vezi cum ai loc? ...dintre ele cu denumiri foarte catchy, care atrag foarte mult şi care postează la un moment dat o întreagă reţea de ştiri de acest tip false. Vorbesc de reclamele încă o dată, toate acestea fiind direcţionate plătite aceste reclame prin intermediul companiilor cu legături certe în Federaţia Rusă.

Prezintă interes faptul că majoritatea paginilor de Facebook menţionate au fost create în perioada 2022-2024, având alte denumiri şi abordând, după cum spuneam, tematici din spectrul reţetelor medicinei alternative, religios, cele patru mari narrative de care vorbeam. Au dobândit prin aceasta un nivel de interacţiune şi vizibilitate foarte ridicat. Iar ulterior, după cum vom arata, au fost activate în contextul premergător scutinului electoral din anul 2024 pentru a redirecţiona utilizatorii către site-uri de acest tip clone cu teme politice de această dată de promovare a candidatului independent.

Un exemplu în acest punct de vedere, unul dintre multele site-uri astfel identificate, site-ul Ce zice lumea, din ecosistemul de care făceam vorbire şi pe care sunt promovate în general narrative cu impact emoţional puternic din sferele despre care vorbim. Din nou, tehnologia Native Ads, utilizată la nivelul acestui site, a fost furnizată de una dintre cele patru companii cu legături certe în Federaţia Rusă. Ulterior, accesării site-ului, utilizatorii sunt redirecţionaţi către site-uri maliţioase ce promovează un conţinut similar.

Iar acestea la rândul lor, prin simplul click pe o ştire care interesează sau care atrage atenţia, redirecţionează utilizatorii pe pagini clonă ale unor trusturi de ştiri autoctone sau instituţii publice. Vedeţi aici un tip de ştire, de exemplu, acelaşi tip de ştire, acelaşi conţinut, acelaşi format care este, prin această metodă de redistribuire, aruncat pe două site-uri clonă, unul a unei companii de televiziune, celălalt al Ministerului Sănătăţii. Un alt exemplu, romaniaculturală.eu este unul dintre site-urile către care se direcţionau aceste site-uri de tip clickbait şi care la rândul său, prin simplu accesară, face trimitere către un outlet numit ronews.com. Acesta, la rândul său, după cum spuneam, redirecţionează utilizatorii pe plagini clon ale unor trusturi de ştiri autoctone sau instituţii publice, după cum se vede şi în aceste imagini.

De remarcat că site-ul intermediar, acest ronews.com de care am făcut referire, a fost descoperit şi în alt ecosistem cu aceleaşi caracteristici tehnice, interfaţa site-ului fiind identică de fiecare dată. În cadrul acelui ecosistem se regăsesc şi site-uri în limba poloneză şi cehă, un aspect relevant fiind reprezentat de alegerile din cele două ţări din cursul acestui an. Alte exemple de pagini de Facebook de această dată, care redirecţionează direct către site-uri clonă de tipul celor care vorbeam, este un exemplu care direcţionează din nou către site-ul unei agenţii de presă.

Toate aceste pagini de Facebook de care vorbim, având în spate domenii înregistrate cu IP-uri de Federaţia Rusă, cum este exemplul la care ne-am referit şi în acest slide. În ultimul rând, atrage atenţia pentru a înţelege diversitatea şi multitudinea acestor tipuri de site-uri clonate, care îi induc în eroare foarte uşor utilizatorii şi anunţul Ministerului de Interne care recent a prezentat faptul că a reuşit să identifice şi să închidă peste 160 de conturi de TikTok care utilizau ilegal însemnele poliţiei. Care sunt rezultatele şi ce se urmăreşte practic prin crearea acestei infrastructuri? În primul rând, întreţinerea unei stări constante de teamă, confuzie, revoltărându-l opiniei publice, tocmai prin prezentarea unor ştiri cu un astfel de conţinut incitator întotdeauna la emoţie şi la stare de revoltă, în genul multe ori, chiar împotriva autorităţilor.

Prin crearea acestor nişe, deja targetate din perspectiva receptibilităţii şi narrativelor la care răspund, se reuşeşte inclus de anumitor segmente de populaţie anumite nişe comportamentale şi informaţionale. Unde sunt fidelizate timp de doi ani de zile prin această reţea de care vorbim, reţea care este activată ulterior în preajma scutinulor electorale prin transmiterea altor mesaje, dar care, ca urmare a nişerii populaţiei respective, prinde un grad de receptivitate foarte ridicat. Spuneam de asemenea generarea unui sentiment de neîncredere în autorităţile statului, pentru că toate aceste ştiri puternice, senzaţionale, cu apel la emoţie duc întotdeauna la polarizarea populaţiei şi cum, prin raportare la autorităţile statului şi, evident, un alt element pe care îl constatăm cu toţii atât de bine astăzi, fragmentarea şi polarizarea societăţii în cât mai multe grupuri de opinie.

Exemplul şi imaginea de aici ne arată cât de uşor o astfel de campană de dezinformare doar pe un anumit subiect poate produce rumoare şi panică în rândul populaţiei. Noi am postat aici o situaţie a acelei campanii pe care o mai reţinesc cu toţii probabil când au, total falsă şi generată prin această infrastructură la care făceam vorbire, cu privire la creşterea preţului la motorină, încât au ajuns cu cetăţenii de-ai noştri să meargă să o cumpere inclusiv la pungă la momentul respectiv. Obiectivele urmărite.

În primul rând, cum spuneam, crearea unor curente de opinie exploatabile, includerea unor segmente de populaţie, anterior identificate în anumite nişe informaţionale şi păstrarea lor în aceste nişe informaţionale. Şi doi la mână, pregătirea acestei infrastructuri pentru activarea în perioada unor momente cheie, primul şi cel mai edificator fiind cel ascutin electoral din 2024, dar după cum vom vedea, el se replică şi această infrastructură începe să fie folosită şi în continuare în alte situaţii similare, inclusiv din cursul anului 2025. În fine, următoarea etapă de care vorbeam din campania de dezinformare, o reprezintă amplificare.

Ai narativele cu care ai captat populaţie, ai interesul populaţiei, ai deja zona de infrastructură pe care o foloseşti. Această infrastructură este folosită în momente cheie pentru dirijarea unor anumit conţinut pentru segmentele de populaţie anterior identificate. Câteva puncte cheie sunt importante de reţinut.

Majoritatea paginilor din infrastructura la care am făcut referire au fost create anterior anului 2024, cu cel puţin doi ani înainte, având alte denumiri, abordând iniţial tematici din spectrul celor patru narrative la care vorbeam. În contextul premergătos cu timpul electoral, această infrastructură este activată cu narative de susţinere a candidatului independent aproape în totalitate. Totodată, conex şi în aceeaşi perioadă a lansării acestor narative de susţinere electoral.

Au existat şi activităţi de microtargetare, care au vizat postarea unor materiale video în cadrul reţelului de socializare, cu scopul de a testa şi verifica predispoziţia publicului la diferite variaţii ale cestei tematici, pentru a vedea care tip de mesaj de susţinere este mai receptiv în mântul opiniei publice, segmentelor identificate, pentru a le adapta pe toate celelalte ulterior. Şi în acest sens dăm un exemplu a unui site de Telegram. Întreaga această infrastructură şi întreaga această activitate este gestionată prin canale de Telegram în legături certe cu Federaţia Rusă.

Acest canal la care facem referire în momentul de faţă, Propagator, a fost înfiinţat în 15 iunie 2024 şi a fost deredenumit în 4 august 2024 în Propagator, implică teşiture, naşterea României, site-ul pe care îl vedeţi acolo. Interesant cu acest canal e faptul că, pe lângă că are un număr foarte mare de urmăritori, al căror rol este să distribuie mai departe conţinutul plasat pe acest conţinut de Telegram, din analiza conţinutului postat în cadrul canalului a rezultat că membrii acestuia au primit instrucţiuni clare referitoare la campania de viralizare a fostului candidat independent. Şi dăm câteva exemple doar.

Au fost puse la dispoziţie peste 1850 de materiale foto-video, reprezentând materiale video editate, limitate la 60 de secunde de conţinut pentru a putea fi postate pe reţelele sociale, dar şi emisiunii de cu 10 ani înainte, în cadrul căror acesta fusese invitat. De asemenea, au fost postate materiale îndrumătoare, tutoriale ale unor aplicaţii mobile de editare foto-video, instrucţiuni cu privire la modalitate de distribuire şi de postare pentru a evita restricţiile platformelor de socializare. Au fost ataşate de asemenea bannere, fotografii de profil cu sigla CG11, sondaje de opinie şi exit poluri falsificate.

Materiale video fabricate reprezentând imagini din România, focalizate pe probleme precum apă, hrană, energie, pe fundalul cărora rulează vocea fostului candidat independent, informării referitoare la momentele oportune de viralizare a acestui conţinut. Acesta este unul dintre exemplele identificate şi nu este singurul. Totodată, la nivelul grupului de Telegram, au fost testate mai multe tipuri de conţinut, mesaje, care erau adaptate pe specificul de microtargetare, fiind destinate unor nişe emoţionale, pregătite anterior, după cum spuneam, şi cultivate prin expunerea sistemică la conţinut specific, furnizate sursele de propagandă produse activă în spaţiu naţional.

Este de remarcat, de asemenea, şi utilizarea unor site-uri mainstream, cum este site-ul Pravda. Reţeaua Pravda face parte dintr-un grup creat pentru a răspândi propagandă în Europa, având nume ale domenilor similare, platforme caracteristice tehnice identice, adresa IP comună găzduită pe un server din Rusia, aceeaşi arhitectură HTML, aceeaşi grafică, aceleaşi secţiuni, aceleaşi link-uri externe. În 2024, deci în preajma alegerilor electorale, nu doar din România, reţeaua s-a extins în alte 19 state, din UE şi din alte regiuni, domeniul din România făcând parte din cel de-al 2-lea val al lansărilor, de altfel de site-uri, împreună cu multe dintre statele din Europa de Est.

Mesajele diseminate pe acest site s-au pliat pe principale narative de dezinformare: Justificarea agresiunii împotriva Ucrainei, plasarea responsabilităţii asupra statelor occidentale pentru întreţinerea şi iniţierea acestui conflict. În perioada premergătoare scrutinului prezidenţial, activitatea în întreg site-ul Pravda s-a intensificat.

Toate ştirile postate în acest interval, mai ales în perioada 25-a, 11-a, 6-a, 12-a, fiind de număr de circa 1230, au vizat exclusiv subiectul alegerilor din România şi candidatul independent la alegeri, promovând retorici extremiste, naţionaliste, indicându-l ca principal exponent al acestora pe candidatul independent. Câteva exemple simple identificate pentru a înţelege mai uşor cum se diseminau astfel de ştiri. De exemplu, Pravda publică la nivelul publicaţiei de Republica Moldova, acest pliant propagandistic, reprezentând imaginea României mari, în care se regăsesc şi teritoriile dinainte de 1940.

În cadrul pliantului a fost regăsit un QR-code, ce făcea trimitere spre site-ul candidatului independent, din care era promovat programul electoral al acestuia transmise în termenul de susţinere a candidatului. Pliantul prezentat a fost iniţial postat pe un canal de Telegram, New Military Columnist, identificat de asemenea în infosfera rusă şi utilizat cu scopul diseminării de mesaje maliţioase de manipulare, având peste 200.000 de urmăritori care viralizează subiectul mai departe.

Un alt exemplu de manipulare.

Ştim cu toţii articolul care a circulat foarte mult în perioada respectivă, un material video fiind evidenţiată o coloană militară înconjurată de populaţii, articolul a fost redactat într-un mod tendenţios la acea dată, cu scopul inducerii unor sentimente panicarde privind politica NATO în contextul conflictului ruso-ucrainian şi implicaţii pentru România, făcând trimitere la evenimente similare din Finlandia.

Ei bine, în cadrul articolului a fost identificat un hiperlink ce făcea trimitere la un canal de Telegram rusesc, Alexander Smechenko, prin care au fost mediatizate şi acţiunile de mobilizare, din nou ştiri false ale armatei finlandeze în proximitatea frontierei cu Rusia. Materialul a fost preluat tot de pe un canal de Telegram, Info Defence Room, regăsit din nou la nivelul infosferii ruse şi utilizat în vederea diseminării de narative de dezinformare.

Retorica este clară, caracterul fals al acestor ştiri care s-au viralizat masiv în România la acel moment este mai mult decât evident, în realitate era vorba de repetiţii din cadrul paradei militare de 1 decembrie, după cum ştim cu toţii.

Pe lângă această campanie de doppelganger, care a urmărit cu 2 ani înainte de campania electorală din anul 2024, după cum spunea, microtargetarea şi nişarea informaţională a unor segmente din populaţie, în preajma cifrului electoral din 2024, pentru viralizarea suplimentară a acestui tip de conţinut, s-a folosit foarte mult şi în campania TikTok, lucruri de care se ştiu. Avem în vedere, din acest punct de vedere, intensificarea virulentă a activităţii de promovare electorală a candidatului independent pe TikTok şi expunerea acestuia în cadrul platformei cu un caracter coordonat, realizată printr-o reţea de conturi deja identificate, vorbim de o reţea de peste 20.000 de boţi, e reţea creată în perioada 2022-2023, păstrată în adormire, cum se spune, dar activată cu o zi înainte de primul tur al alegerilor, momentul în care a postat peste 2 milioane de comentarii în subsolurile articolurilor de acest tip, lucru care a adus la o viralizare excesivă.

Conturile au fost create utilizând adrese de e-mail cu domenul rambler.ru înregistrat în Rusia şi prezintă, după cum vedeţi, multe indicatori specifice a automatizării şi unei activităţi coordonate, de asemenea o activare specifică a mai multor conturi alegenţiei Sputnik care se mută, practic, cu atenţia şi cu ştirile pe care le publică de la acel moment de pe Republica Moldova pe România. În fine, inclusiv compania TikTok în urma solicitorilor noastre a realizat o analiză amplă asupra modului în care s-a derulat acest conţinut în cadrul platformei şi conform unui raport public care se regăseşte în acest moment, el poate fi accesat la adresa pe care o menţionăm în slide-ul afişat, au fost identificate două reţele coordonate care au operat pe teritoriul României în noiembrie şi decembrie în vederea promovării candidatului independent. Aceste campanii au urmărit exploatarea vulnerabilităţilor generate de lipsa respectării politicilor platformelor, defiltrarea conţinutului viralizat prin intermediul postării de comentarii.

Manipularea algoritmului, după cum ne arată inclusiv un raport oficial TikTok, a fost realizată preponderent prin utilizarea succesivă în cadrul materialelor video a unor hashtag-uri afiliate candidatului independent şi menţionarea acestuia în secţiunea de comentarii aferentă materialelor video populate în cadrul platformei. Care este rezultatul acestei campanii? A dus la o amplificare artificială a expunerii conţinutului propagandistic în beneficiul candidatului independent. De asemenea, direcţionarea mesajelor de acest tip special create către acele segmente ale publicului românesc anterior selectate în urma procesului de microtargetare a populaţiei, lucru care face ca unul dintre hashtag-urile candidatului independent să ajungă la momentul alegerilor prezidenţiale, chiar pe locul nou la momentul viralizării la nivel mondial.

Astfel de comportament au potenţat acţiunile conturilor coordonate de amplificarea artificială a expunerii conţinutului propagandistic în beneficiul candidatului. Da, popularizarea acestuia la nivelul urmăritorilor săi şi comunităţii care vizualizează în mod regulat transmisiunea indirectă pe această platformă. Trebuie să vedem de asemenea cum a operat această viralizare şi la nivelul diasporei unde în toate componentele, în toate ţările unde ai de diasporă românească, hashtag-urile aferente fostului candidat s-a urcat, ca urmare a urcat, ca urmare, acestei campanii coordonate de amplificare artificială a viralizării, cel puţin în primele 10 locuri.

Nicăieri nu a fost sub 10. În unele dintre ele, unele hashtag-uri chiar pe locul întâi. O dovadă în plus a coordonării existente în spatele acestei campanii de promovare a reprezentat-o şi faptul că după rezultatul primului tur al alegerilor prezidenţiale, cu vârful semnalat undeva între 27, 28 şi 18, după data de 29 a 11-a, se remarc o scădere progresivă şi bruscă a acestei campanii, pentru că întreaga infrastructură se decompensează după rezultatul primului tur şi aşteaptă să vadă, probabil, cum se reconfigurează lucrurile în spectrul politic românesc.

Se observă, de asemenea, din graficul alăturat, îndreapta faptul că la nivel mondial, în 6 a 12-a, deci deja la câteva zile sub o săptămână, în tendinţă, n-au mai fost identificate deloc hashtag-urile conexe candidatului la legările prezidenţiale, iar în România uneori l-au luat cu 22, altele deloc. În fine, un alt element important al acestei campanii de dezinformare o reprezintă rezistenţa şi relansarea, ceea ce înseamnă că atunci când platformele elimină sau etichetează un conţinut maliţios, fie pentru că identifică, în urma frismului simplu, procese de filtrare, fie la solicitarea autorităţilor româneşti, în cazul de faţă, operatorii pot schimba domeniile, pot muta această infrastructură şi reincep ciclul sub alte denumiri. Şi dăm un exemplu cât se poate de concret din acest punct de vedere, pentru a înţelege că această infrastructură a fost, este şi probabil va fi folosită şi pe viitor, pentru influenţarea opiniei publice în momente cheie identificate de agresori.

Dăm ca exemplu acţiunea de boicotare a supermarket-urilor din luna februarie 2025, care a fost coordonată cross-platform cu o campanie derulată la nivelul TikTok şi care a utilizat hashtag-ul curăţenie generală, este lansată din întreaga infrastructură pro-rusă, legăturile de acest tip cu respectiva campanie sunt similare celor ce v-am arătat în ceeaşi duşte campania electorală din 2024, de remarcat că în urma acestei campanii de viralizare, hashtag-ul curăţenie generală, înregistrează o creştere de asemenea artificială, dar exponenţială, în ceea ce priveşte accesările şi vizualizările, astfel încât în 22 ianuarie, acumulează 156 de milioane de vizualizări, ajungând undeva la locul 4 în tendinţele de utilizare a hashtag-urilor la nivel naţional. Un alt exemplu la fel de edificator de folosire în continuare a acestei infrastructuri, în mai 2025, în cadrul ecosistemului de pagini Facebook, la care am făcut deja referire, a fost postat în mod coordonat o imagine, al cărei titlu este redactat sub forma unei ştiri de tip clickbait. Accesarea acestei pagini trimite automat către un anumit domeniu, româniaculturală.eu, l-am mai menţionat în prezentarea de astăzi, unde sunt afişate diferite reclame maliţioase.

Ultelor accesării acestora, ele redacţionează către site-uri de tip doppelganger, încă o dată, site-uri clonă, ale Ministerului Sănătăţii, trusturi de media, unde se regăsesc apoi o multitudine de materiale de dezinformare pe aceeaşi temă. Reclamele din nou pe aceste site-uri sunt plătite şi promovate de una din companiile certificate de colegături în Federaţia Rusă. Cu precizarea că această ştire, din nou cu impact emoţional puternic la anumite segmente ale populaţiei, fusese postată iniţial în februarie 2025 şi este repostată în alt ecosistem, dar cu acelaşi mod de operare şi din nou în aprilie 2025 pentru a fi repostată în site-urilor maliţioase.

Continuă să prezinte capabilităţile necesare influenţării pe scară largă a populaţiei autoctone, iar schimbarea tiparului acestuia, pe momente cheie, indică versatilitatea tehnicilor de manipulare a actorilor ostilii. Această infrastructură informaţională a fost creată şi activată ca şi concluzie, încă din 2022, pentru promovarea unor mesaje subliminale la nivelul spaţiului informaţional autocton, pentru cultivarea unor sentimente antisistem la nivelul audienţelor vizat. În contextul alegerilor din 2024, această infrastructură a fost utilizată pentru influenţarea mentalului colectiv, în vederea dezvoltării unor idei care să corespunde discursului candidatului antieuropean, aceste manifestări asigurând să adispaje unui obiective strategice al unui actor străin.

Şi nu în ultimul rând, adaptabilitatea acestei infrastructuri maliţioase a permis modelarea unei percepţii antisistem exploatabile în contextul unor evenimente care ar putea genera efecte în favoarea actorului străin. Că vorbim de procese electorale trecute sau viitoare, de crize de ordine publică, crize politice, economice sau de altă natură.