Pentagonul refuză să spună dacă a folosit inteligenţă artificială pentru a selecta şcoala elementară ca ţintă a bombardamentelor în Teheran

În urma atacurilor aeriene ale forţelor SUA care au distrus o şcoală şi au curmat viaţa a 165 de elevi şi membri ai personalului şcolar iranian, Pentagonul a refuzat să declare dacă atacul a fost sugerat de un sistem de inteligenţă artificială, scrie Futurism.com.

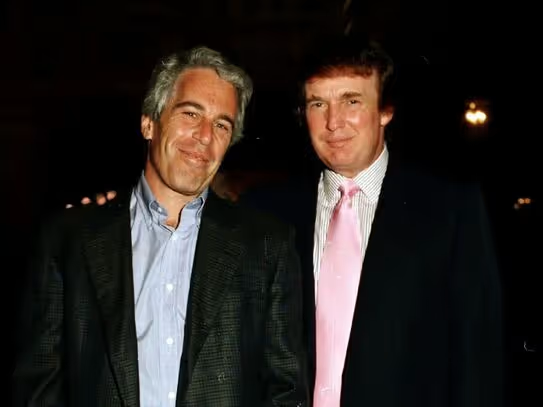

Această posibilitate grotescă nu este atât de improbabilă pe cât pare. Potrivit unui reportaj bombă publicat de Wall Street Journal, Pentagonul a folosit modelul de inteligenţă artificială Claude al Anthropic pentru a planifica atacurile militare asupra Iranului din weekend — şi probabil că îl foloseşte în continuare, având în vedere că atacurile administraţiei Trump continua.

În prima salvă, fie SUA, fie Israelul — deşi informaţiile disponibile indică prima variantă — au distrus şcoala de fete Shajareh Tayyebeh, situată în oraşul Minab, din sudul Iranului. Majoritatea persoanelor ucise în atac, conform Al Jazeera, erau elevi de şcoală primară cu vârste cuprinse între 7 şi 12 ani. Cel puţin alte 95 de persoane au fost rănite în atac.

Situaţia este şi mai gravă, conform Middle East Eye, care arată că Shajareh Tayyebeh a fost lovită a doua oară după primul atac cu rachete, rănind echipele de prim ajutor şi părinţii care veniseră să-şi ia copiii. Aşa-numitul „double tap” (lovitură dublă) aminteşte de bombardamentele americane asupra navelor civile din Venezuela sub Donald Trump şi de atacurile aeriene din Pakistan organizate de administraţia Barack Obama.

Având în vedere că Statele Unite au raportat utilizarea IA pentru a selecta cel puţin unele ţinte militare în Iran, o întrebare importantă rămâne fără răspuns: au folosit SUA Claude pentru a decide dacă să distrugă o şcoală elementară?

În aprilie 2024, o anchetă realizată de 972 Magazine a dezvăluit că armata israeliană a folosit un sistem de inteligenţă artificială numit „Lavender” pentru a selecta ţinte în războiul său din Gaza, similar modului în care Pentagonul ar folosi Claude în Iran. Potrivit a şase ofiţeri de informaţii israelieni, Lavender a jucat un „rol central” în distrugerea Gazei şi a populaţiei sale, identificând cel puţin 37.000 de palestinieni ca ţinte pentru asasinate aeriene.

După cum a declarat un agent de informaţii pentru 972, deciziile Lavender – care adesea implicau sugestii de a ataca ţinte în propriile lor case – erau tratate „ca şi cum ar fi fost decizii umane” de către agenţii militari.

Consecinţele etice ale unui astfel de sistem sunt greu de exagerat. O sursă militară israeliană a declarat pentru Guardian: „În această etapă, investeam 20 de secunde pentru fiecare ţintă şi făceam zeci de astfel de operaţiuni în fiecare zi. Nu aveam nicio valoare adăugată ca om, în afară de a fi o ştampilă de aprobare. Economiseam mult timp.”

Această tendinţă prevesteste o nouă eră brutală a războiului, în care nu mai este clar dacă oamenii, sau cel puţin oamenii singuri, iau decizii de viaţă şi de moarte cu privire la locul în care să folosească cel mai mortal arsenal din istoria umanităţii – chiar şi atunci când victimele sunt zeci de şcolari.